Regular el caos

La importancia de las redes sociales

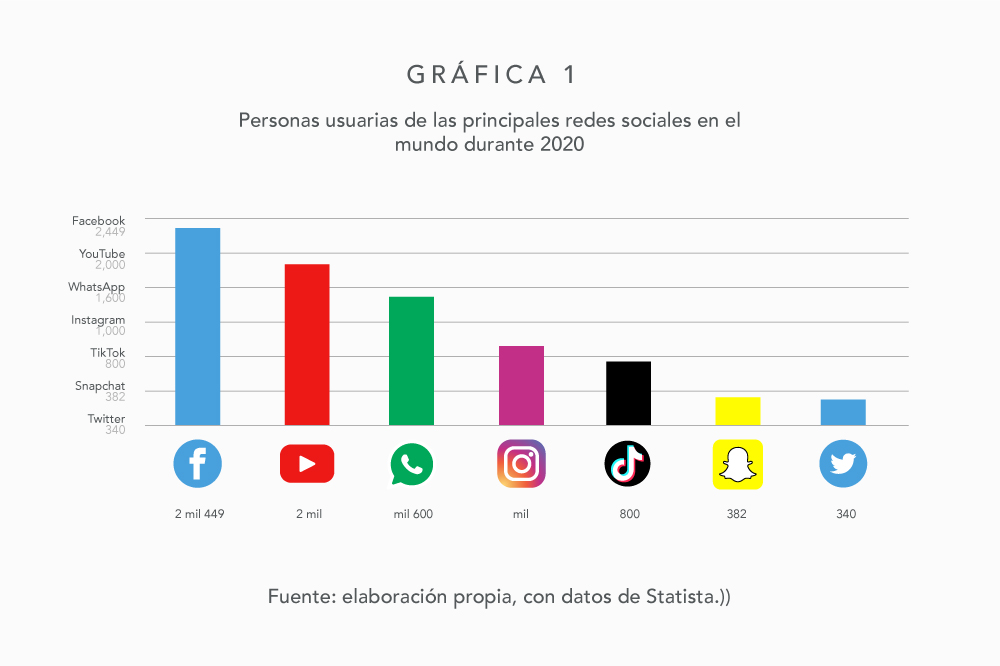

2.7 billones de personas en el mundo tienen una cuenta de Facebook; Instagram cuenta con aproximadamente un billón de usuarias y usuarios; Twitter, alrededor de 300 millones por mes; YouTube, 2 billones; TikTok —red social china de reciente creación y cuyo contenido son videos cortos— tuvo 738 millones de descargas en 2019, y 1.6 billones de personas acceden a WhatsApp mensualmente. Y aunque estas cifras varían, son indiscutiblemente masivas (Gráfica 1). Se trata de plataformas con un alcance cuyo crecimiento ha sido exponencial, y las cuales son muchas veces la principal fuente de información para las personas, además de haber sido el lugar en donde iniciaron movimientos que tuvieron repercusiones en la vida pública de las sociedades.

A través de las redes sociales se iniciaron movimientos que dieron pie a lo que hoy se conoce como la primavera árabe, mediante la cual países como Egipto o Túnez pudieron liberarse del cariz autoritario de sus gobiernos. Gracias a las redes sociales, en algunos países, incluido México, se ha podido dejar atrás el cerco mediático que los movimientos que enfrentaban al poder y, por lo tanto, a los medios convencionales, enfrentaban al tratar de alzar la voz. Incluso existen teorías que enfatizan que su aparición ha forzado la profesionalización de los medios de comunicación tradicionales, los cuales se han tenido que apartar del sensacionalismo para presentar información que pueda ser más confiable que la publicada por las personas usuarias de redes sociales.

Pero como casi todos los inventos trascendentales de la historia, las redes sociales también pueden ser utilizadas de manera incorrecta. En 2012, en Birmania un grupo de budistas de corte nacionalista creó un grupo digital en Facebook, cuyo común denominador era el miedo a personas musulmanas. Cinco años después, en 2017, la ONU identificó más de 150 grupos de Facebook en ese país dedicados a generar discursos de odio en contra de esa población. Ese mismo año, un grupo de budistas nacionalistas atacaron aldeas de una etnia musulmana, provocando el éxodo de 725,000 personas a Bangladesh, el país vecino.

Facebook es la fuente de información de dos de cada cinco personas que viven en Birmania, y aunque ha argumentado que muchas de las cuentas de quienes instigaron esta violencia fueron eliminadas, la acción ocurrió después de que el daño estaba hecho, mostrando la necesidad de generar mecanismos que previnieran este tipo de situaciones, sin poner en riesgo la libertad de expresión: un balance y una tarea sumamente complejos, que necesariamente implican la participación de los gobiernos.

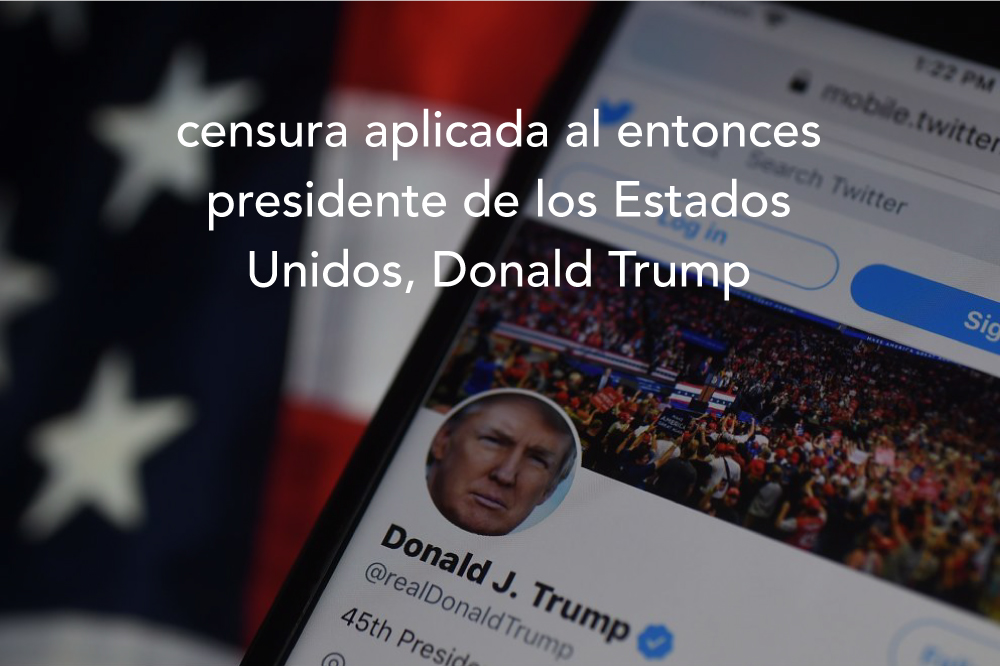

Aunque la participación de los gobiernos en la regulación de redes sociales se intensificó a partir de la censura aplicada al entonces presidente de los Estados Unidos, Donald Trump, lo cierto es que este debate, así como los intentos de algunos países por generar leyes al respecto, fueron anteriores a este episodio. Después de la victoria de Trump y del referéndum británico donde triunfó el Brexit, las redes sociales han estado bajo presión para generar mejores mecanismos de control que eviten la proliferación de noticias falsas, de contenido ilegal y de discursos de odio. Parte de esta presión proviene de legislaciones nacionales en las que se ha buscado limitar la actuación de estas empresas.

Ejemplos internacionales de intentos por regular las redes sociales

En 2017, en Alemania, el Parlamento aprobó la Ley de Aplicación de Redes o NetzDG (versión reducida de su nombre en alemán), con el fin de reforzar los límites a la libertad de expresión y evitar mensajes de odio que pudieran incidir en el aumento de la comisión de delitos. La legislación alemana obliga a las redes sociales con más de 2 millones de personas usuarias registradas en Alemania a retirar de manera local el contenido ilegal “evidente” en un plazo máximo de 24 horas tras recibirse la notificación. En caso de duda, el proveedor dispone de hasta siete días para tomar una decisión. En caso contrario, las empresas podrán ser acreedoras a multas de hasta 50 millones de euros. No obstante, se vertieron opiniones en contra por parte de voces opositoras, en el sentido de que esa ley externaliza la impartición de justicia, al obligar a las redes a tomar decisiones sobre la legalidad o no del contenido subido a sus plataformas.

En 2019, el presidente francés Emmanuel Macron declaró su intención de regular la actuación de las redes sociales. La propuesta inicial era similar a la alemana: las redes sociales tendrían 24 horas para retirar contenidos de odio; de no hacerlo, serían multadas con un cuatro por ciento del equivalente sus ganancias globales. Esta intención derivó de la publicación de un informe elaborado en conjunto por el gobierno galo y Facebook, sobre la responsabilidad de las redes sociales, el cual señala que “las autoridades francesas deberían tener más acceso a los algoritmos de Facebook, para auditar sus políticas sobre incitación al odio”.

Precisamente, la intención de regular las redes sociales, así como el incremento de discursos de odio y noticias falsas, ha llevado a empresas como Facebook y Twitter a tratar de autorregularse, mayoritariamente a través de lo que se conoce como machine learning, que puede ser traducido al español como “aprendizaje automático”. En síntesis, este sistema permite generar un algoritmo a partir del cúmulo de datos recibido a través de las publicaciones de las personas usuarias de cada red social.

Con base en criterios preestablecidos, el algoritmo puede identificar lo que se considera como material inapropiado y lo que no, para decidir qué contenido se permite publicar. Esto ha provocado que las redes sociales eliminen un número cada vez mayor de cuentas que son consideradas como falsas o aquellas que publiquen material inapropiado. Actualmente Facebook elimina 17 millones de cuentas diariamente, más del doble de lo que hacía hace tres años; en el segundo trimestre de 2020, YouTube, una plataforma de video propiedad de Google, eliminó 11.4 millones de videos; en el segundo semestre de 2019, Twitter hizo lo propio con 2.9 millones de tuits, y TikTok removió 105 millones de videos en la primera mitad de 2020 (The Economist, 2020).

La mayoría del contenido se elimina a partir de los algoritmos diseñados por cada red social, mecanismo que, por sí mismo, las convierte no solamente en plataformas donde las y los usuarios publican materiales libremente, sino que, de manera natural, los inclina hacia un rol de editorialistas, en el cual se puede decidir censurar o no ciertos tipos de contenido. Esto abre dos preguntas importantes: ¿cuáles son los contenidos permitidos? ¿De qué manera y quién decide qué es considerado como material publicable?

El reporte y la intención de regular las redes sociales en Francia desembocó en la aprobación de la Ley Núm. 388, conocida también como Ley Avia, con la cual se imponía la obligación de buscadores, redes sociales y otras páginas y aplicaciones de eliminar el contenido manifiestamente ilegal que incluyera discursos de odio; sin embargo, el Consejo Constitucional de Francia determinó, en junio de 2020, su inconstitucionalidad. Asimismo, el Tribunal de Justicia de la Unión Europea determinó que los motores de búsqueda no están obligados a retirar contenido a nivel global (únicamente a nivel local), cuando lo exija la autoridad de algún Estado miembro de la UE.

Cuatro meses después de la decisión de la Corte francesa, en octubre de 2020, el profesor francés Samuel Paty utilizó el diario Charlie Hebdo —el cual caricaturiza la religión musulmana— para ilustrar en clase la importancia del respeto a la libertad de expresión. Algunos padres, de origen musulmán, se quejaron de esta actividad, y al mismo tiempo se empezaron a generar videos que fueron publicados en Facebook para pedir la renuncia del profesor. El efecto en redes sociales fue profundo. Se inició una bola de nieve cargada de odio, la cual desembocó en el homicidio del profesor. Esto ha llevado al gobierno francés a revivir la discusión sobre la necesidad de regular el contenido en redes sociales, pues claramente la autorregulación no ha sido lo suficientemente efectiva.

El asesinato de Paty provocó que Francia endureciera su posición ante la Comisión Europea, institución que a finales de 2020 presentó una propuesta al Consejo y al Parlamento Europeo para legislar un conjunto común de normas sobre las obligaciones para prestar servicios digitales en la Unión Europea, garantizando un elevado nivel de protección a las personas usuarias.

La regulación contempla nuevas obligaciones para distintos agentes, proporcionales a su tamaño, papel e impacto en el ecosistema en línea, que pueden ser: intermediarios que ofrecen infraestructuras de red, proveedores de acceso a internet y registros de nombres de dominio; servicio de alojamiento de datos, tales como servicios en nube y de alojamiento web; plataformas en línea, cuando reúnan a vendedores y compradores, sean tiendas de aplicaciones, plataformas de economía colaborativa y redes sociales, y plataformas en línea muy grandes, cuando lleguen al 10 por ciento de los 450 millones de personas usuarias en Europa.

Las obligaciones comunes serían informes de transparencia, cooperación con las administraciones nacionales, contar con puntos de contacto y, en su caso, representantes legales. Además, existirían obligaciones acumuladas para los cuatro supuestos mencionados en el párrafo anterior, como mecanismos de reclamación y resolución extrajudicial de litigios para las dos últimas, y auditorías externas de riesgos y códigos de conductas para las plataformas muy grandes.

Por su parte, en Estados Unidos se plantea una reforma al artículo 230 de la Ley de Decencia en Telecomunicaciones, tanto el Partido Demócrata como el Republicano han formulado una serie de iniciativas en el Congreso para discutir los alcances de la inmunidad de las redes y hacerlas responsables del contenido que en ellas se publica. Se vaticina que se creen agencias u organismos no gubernamentales bajo la supervisión de agencias del Estado, para regular la protección de datos personales, la competencia y la resolución de conflictos. Para crear una regulación regional, la Organización de los Estados Americanos podría ayudar a desarrollar un modelo de gobernanza. Algo que el mismo Joe Biden dijo durante su campaña fue que es necesario que empresas como Twitter y Facebook hicieran más para evitar la propagación de noticias falsas.

Este tipo de propuestas están enfocadas en distintos puntos, pero todas tienen un común denominador: la necesidad de que las redes sociales amplíen la transparencia de sus mecanismos de monitoreo y de decisión editorial. De hecho, recientemente, el Grupo de Trabajo sobre Infodemia, organizado por el Foro sobre Información y Democracia elaboró un reporte en el que se emiten diversas recomendaciones sobre cómo debería llevarse a cabo la regulación de las redes sociales, enfatizando que la regulación pública es necesaria para asegurar los requisitos de transparencia de todas aquellas empresas que presten servicios a través de internet. En este sentido, la regulación pública en la materia debe cumplir con tres recomendaciones:

- Los requisitos de transparencia se deben relacionar con las funciones básicas de todas las plataformas en el ecosistema de información pública: moderación, clasificación y orientación de contenido, y creación de influencia social.

- Los reguladores a cargo de hacer cumplir los requisitos de transparencia deben tener sólidos procesos de supervisión y auditoría democráticos.

- Las sanciones por incumplimiento podrían incluir multas elevadas, publicidad obligatoria, responsabilidad de quien encabece la dirección ejecutiva y sanciones administrativas, como el cierre del acceso al mercado de un país.

Estos son sólo algunos ejemplos de los esfuerzos que algunos países e instituciones han realizado para tratar de regular uno de los aspectos problemáticos con las redes sociales: evitar la desinformación y la proliferación de discursos de odio, y al mismo tiempo proteger la libertad de expresión.

La autorregulación y sus limitaciones

Es necesario reconocer que empresas como Facebook y Twitter han avanzado en su autorregulación. La tecnología —la automatización de la eliminación de contenido—ha provocado que el 99 por ciento de las publicaciones que contenían pornografía infantil sean removidos de manera automática, pero materiales ofensivos de otro tipo, como aquellos de acoso infantil, generalmente tienen que ser aún denunciados por las personas usuarias.

Además de estos esfuerzos, Facebook actualmente emplea alrededor de 15 mil personas para moderar su contenido, lo cual muestra la intención por tratar de coadyuvar en la selección del considerado como publicable o censurable. Sin embargo, el alcance de estas redes —cuatro de cada 10 personas en el mundo utilizan Facebook— obliga a que los gobiernos nacionales se sigan esforzando para asegurar el derecho a la libertad de expresión por un lado y, por otro, evitar que los discursos de odio o la desinformación tenga consecuencias directas en sus sociedades.

Hechos recientes, como la decisión humana y no automatizada de bloquear las cuentas del entonces presidente Donald Trump o la de eliminar cuentas identificadas como afines al presidente Andrés Manuel López Obrador, han elevado el nivel de debate en torno al tema tanto en México como en Estados Unidos.

Suspender al presidente Trump a sólo unos días de que terminara su mandato, cuando había utilizado tanto Twitter como Facebook durante cuatro años para mandar mensajes que eran igual de censurables, levantó suspicacias sobre la temporalidad y, por lo tanto, de la objetividad de la decisión. La cancelación de cuentas de Twitter que apoyan al actual gobierno de México, pero no a aquellas que lanzan mensajes de odio al presidente, pone en entredicho la aplicación igualitaria de los términos y las condiciones de esa empresa.

Hoy existe consenso respecto a que cualquier algoritmo de automatización tiene un sesgo de entrada, que se origina en su diseño, y que además la automatización ha fallado en algunas ocasiones; el caso del profesor francés es un ejemplo, pero también la publicación del video de la matanza en Nueva Zelanda que permaneció publicada en las redes sociales durante varias horas son casos que muestran la necesidad de ir más allá de la autorregulación. A esto se suma que, en momentos críticos, como lo sucedido en Estados Unidos, existe un componente humano que en el caso de las redes sociales decide qué censurar y qué no, algo que claramente puede ir en contra de la protección que los Estados tienen que brindar al derecho humano de la libertad de expresión.

¿Dónde comenzar?

El argumento en contra de regular públicamente las redes sociales es que se trata de empresas privadas cuyas personas usuarias aceptan los términos y condiciones, y por lo tanto las empresas tienen el derecho de actuar conforme a esos lineamientos. Sin embargo, el servicio que brindan no solamente se otorga a través de infraestructura pública, sino que está comprobado que la falta de una regulación efectiva tiene consecuencias en el orden público, lo cual es enteramente competencia de los gobiernos.

Cuando un Estado violenta el derecho a la libertad de expresión, existen mecanismos que permiten a la ciudadanía defenderse de tales abusos; en México, por ejemplo, tenemos el juicio de amparo. Pero la efectividad de estos mecanismos frente a una empresa privada es nula, por lo que, si una ciudadana o un ciudadano es censurado en una red social o si es ignorado por la misma, al denunciar un daño a su persona no existe mecanismo que pueda proteger su integridad. ¿Cuál puede ser un mecanismo para que esto no suceda? Ése será un punto neurálgico en el debate.

Un segundo punto es cómo mejorar la transparencia de las empresas de las redes sociales. Los algoritmos que desarrollan son parte de su modelo de negocios; en ellos basan qué materiales se borran y cuáles no, y qué productos de venta verá cada persona usuaria en la pantalla, algo que necesariamente nos lleva a otro tema de debate que por sí mismo debe ser explorado: la protección de los datos personales de las personas. La utilización de esa información para inducir compras o las potenciales filtraciones de datos —como sucedió durante la elección presidencial de 2016 en Estados Unidos o con el Brexit en el Reino Unido— obliga a que los Estados nación propongan mecanismos de protección a la integridad de sus sociedades.

Sólo para poner en perspectiva la importancia de los datos, de los 1.9 trillones de dólares del valor de mercado de la compañía que es propietaria de Google y de Facebook, 1.4 provienen de los datos que recaban de las personas usuarias. Se trata de ganancias altísimas, muchas de las cuales no son reportadas en los países donde están las y los usuarios y, por lo tanto, no generan ninguna ganancia para esos territorios. México, como muestra la Gráfica 2, es un mercado muy amplio para las grandes redes sociales, pero aun así, la riqueza que generan a partir del mismo difícilmente es gravable, pues las empresas están constituidas en otro país. En este sentido, otra vertiente de la regulación necesaria tiene que ver con la protección de datos, tal como se ha hecho en la Unión Europea con la Ley General de Protección de Datos o en California con la Ley de Privacidad del Consumidor.

Finalmente, se debe enfatizar que, aunque se trate de negocios privados, el derecho humano a la libertad de expresión está sustentado en el derecho internacional y en las constituciones nacionales y, por lo tanto, ninguna persona debería ser censurada por expresar su forma de pensar, mucho menos si esta medida no es aplicada de manera homogénea o con apego a un procedimiento claro.

Quienes dirigen compañías de redes sociales, como Mark Zuckerberg, de Facebook, y Jack Dorsey, de Twitter, han afirmado que sus empresas siempre buscarán proteger la libertad de expresión, lo cual se ha limitado a la implementación de procesos de automatización, que no han sido totalmente efectivos para acabar con los discursos de odio.

Por otro lado, también han sido suspendidas cuentas consideradas como ofensivas, pero no se han aplicado las mismas medidas de manera homogénea, demostrando así la existencia de criterios subjetivos que necesariamente tienen un sesgo personal al momento de censurar a alguien. Eso no puede seguir sucediendo.

Se trata de grandes negocios que critican la cerrazón de China o la fuerte regulación de Singapur, las cuales les impiden ofrecer allí sus servicios. Es necesario no caer en esos extremos, pero tampoco podemos seguir en el lado contrario: en la total inacción.

El problema sólo se volverá más complejo mientras más tiempo pase, por eso, el debate sobre la regulación a las redes sociales es ya impostergable, pues actualmente la autorregulación ha generado una especie de caos difícil de entender. Es momento de acabar con esa situación, para darle paso al orden, algo que convendría tanto a las empresas de redes sociales como a las sociedades de cada país.

Twitter y Facebook: @RicardoMonrealA